一、产品概述

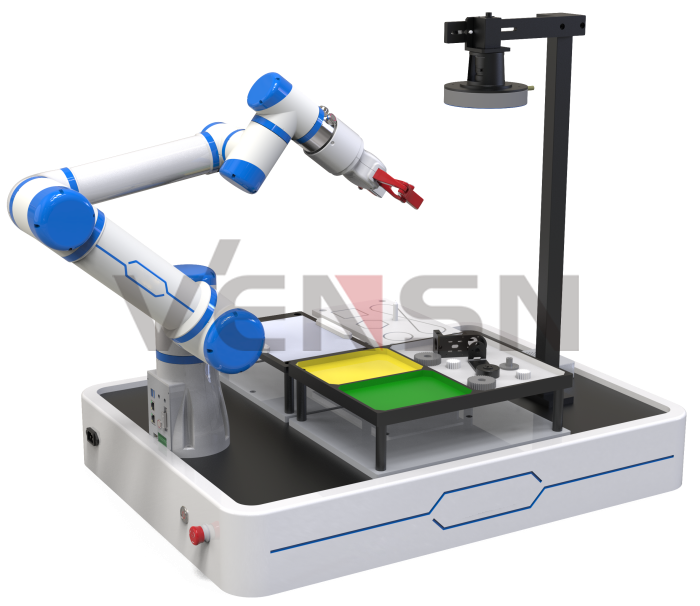

生产线以视觉系统和协作机器人为核心,面向人工智能、机器人应用和智能制造领域中的视觉识别、定位、检测等实际应用,搭建典型的机器人+视觉生产线场景。生产线采用高性能运算单元,部署人工智能软件环境,不仅可以完成常规的数字图像处理、机器视觉、机器人运动控制等基础实验实训,还可以进行相对复杂的字符识别、缺陷检测、目标识别、特征分析等综合性实验。另外,运算单元中实现了DeepSeek、Qwen等开源大模型的本地化部署,支持大模型技术开发、大模型+视觉、大模型+语音、大模型+机器人等多个行业场景的应用实践。

二、功能与应用场景

1.开放性实验环境

实验代码在Jupyter Notebook环境中编写。

2.开放全部源代码

开放全部软件框架和算法级源代码,支持二次开发,提供完善的实验指导书和技术文档,并提供产品相关软硬件的架构与设计方法文档。

3.部署本地大模型

完成了DeepSeek、Qwen等开源大模型的本地化部署,即部署于本机的运算单元中,除了可以开展大模型基础应用的学习外,还可以利用大模型和配置的视觉、语音、机器人、传感器等设备进行交互,面向如智能制造、智能家居、智慧农业等典型场景,开展应用实践。

4.视觉定位、检测与识别

视觉技术在实际应用中,通常有三个方向:定位(即计算目标位置,为机器人抓取提供引导)、检测(即检测目标的缺陷,如零部件划痕、缺角等,用于进行良次品分类)、识别(即识别目标的名称,如识别不同长度的螺杆,用于进行产品种类的分拣)。

本产品在不同的实训项目中,综合运用到了上述三类技术:可以通过视觉系统定位目标的位置,机器人准确抓取;也可以进行目标的缺陷检测,由机器人进行次品剔除;还可以进行目标的尺寸测量或型态识别,由机器人完成目标的分类。用户可以在开源环境下进行自主开发,面向智能制造、智慧物流等多个场景,开展行业应用。

5.机器人手眼标定

为机器人引入视觉系统,使得机器人可进行自主的、智能化的运动,完成如零部件分类、物流搬运、码垛、物体分拣等功能。手眼标定有两种方式:眼在手上、眼在手外。通常来说,对大目标或大范围多个目标的抓取,需要更大的视野,可以采取眼在手外的方式;对小目标的抓取,则可以采用眼在手上的方式。当然,还需要考虑到机器人的负载和安装空间,是否在末端安装了视觉系统后,仍能实现对目标的抓取。本产品综合采用了眼在手上和眼在手外的方式,满足不同场景的视觉使用需求。

6.基于视觉的机器人应用

机器人与视觉系统结合,可以对不同尺寸、外观的目标进行识别,开展目标分拣、智能码垛、物体识别、字符识别等多种人工智能基础实训项目。

7.生产线系统集成

生产线上安装有步进电机、光电传感器,通过IO控制器接入运算单元,实现对生产线的启动、停止、暂停,以及触发视觉系统拍照、控制机器人定点抓取等动作,从而完成集成化系统运行时的全流程动作。

三、主要硬件参数

1.运算单元

采用一台高性能计算机,预装Linux或Windows操作系统,部署DeepSeek、Qwen等开源大模型,并集成Python、OpenCV等运行环境,以及产品运行所需的全部软件框架和SDK,支持数字图像处理、机器视觉、机器人、大模型等硬件或应用的开发和学习。

2.2D视觉系统

2D视觉系统即一套标准工业级视觉系统,包括工业相机、镜头、LED光源、光源控制器等,通过视觉支架进行集成,安装于平台上方,为所有的静态目标检测、分析和处理提供实验的硬件环境。

视觉系统结构如下:

3.深度视觉系统

深度视觉系统采用1台200万像素深度体感摄像头,安装于机器人末端,用于目标的精确定位与机器人引导。摄像头可兼容ubuntu,linux和树莓派等操作系统,兼容USB3.0接口协议,可进行深度信息感知、活体识别等。摄像头内置立体深度算法,可实现更准确的深度感知及更远的范围。通过校准,立体深度感知的误差率低至2%,在室内和室外环境中最远可捕获相距达10米的数据。

4.协作机器人(完全开源)

该机器人是专为教育科研开发的一款产品,融合AI大模型技术,且完全开源,在电机控制上,开放电机、控制器与机器人关节之间的控制源码;在运动学算法上,开放底层运动学正逆解模型的源码。通过全方位的开源,用户可以从事机器人软硬件层面的各类科研、开发工作。

同时,机器人具有工业机器人的性能,提供多个拓展接口,支持视觉、语音、传感器等外设模块的接入,可应用于教学、科研、生产线集成、装配等领域。

5.输送线

输送线上安装有步进电机、光电传感器,通过IO控制器接入运算单元,实现与其他系统模块的协同。

四、实验项目

1、Python程序设计

2、机器学习

3、深度学习

4、数字图像处理

5、机器视觉

6、基于视觉的机器人应用

7、大模型技术基础

8、大模型+视觉应用案例

9、大模型+语音应用案例

五、综合实训

1.机器人的控制

机器人主要由多路电机和外部结构组成,通过对单个或多个电机进行控制,运动到指定角度,即实现机器人的控制。机器人自身可在空间中执行任意点的运动,同时,自带有吸盘,可完成对指定物体的抓取。实训中,通过对电机和吸盘的控制,可操作机器人完成各种丰富的动作;

2.AI+视觉自动仓储

采用AI技术和计算机视觉技术,控制机器人进行仓库货物的自动分拣、整理。运算单元中搭载深度学习算法,视觉系统对货物进行识别和分类,机器人对货物进行多个仓位间的搬运,或者对货物进行整理归位;

3.基于AI的图象识别和抓取

基于运算单元中搭载的算法模型,可进行物体识别与分类、电子产品识别、车牌识别、水果识别、OCR字符识别、产品缺陷检测等应用,并可控制机器人对不同种类的物体进行抓取和分类。

4.机器人大模型调试与部署

运算单元中内置机器人大模型,支持通过语音或文本指令,由大模型自主生成机器人的真实控制代码。用户可在此基础上对大模型进行调参,实现更加丰富的功能,比如开发多模态语境下的物体抓取功能,由机器人自主进行指令分解,生成动作规划,合成为需要执行的动作逻辑,并最终完成物体的抓取;

5.具身智能技术开发与应用

在上述机器人大模型的基础上,可融合视觉、语音、传感器等功能,开发具身智能应用案例。用户发出产品分类需求,机器人可首先调用视觉系统观察环境中的物体,然后通过大模型分析,将产品依次取出,按照类别有序的摆放于操作平台上。比如,对物料筐中的螺丝刀、胶带、轴承等多种型态的物体进行分类。